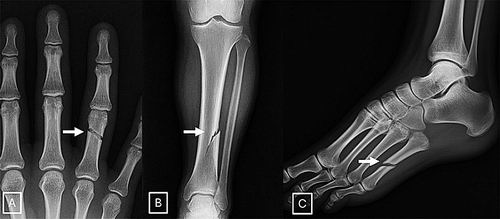

AI生成的X光片让科学家感到担忧。图片来源:北美放射学会

3月24日发表于《放射学》的一项研究表明,大多数放射科医生都无法辨识由人工智能(AI)生成的X光扫描图像,只有不到半数的人能发现隐藏在真实医疗数据中的合成图像。而大语言模型也不能很好地区分真实与合成的医学图像。

这项研究提供了一套培训方案,旨在帮助放射科医生提升识别AI生成的X光图像的技能。研究人员强调,合成数据的负面影响,可能会渗透到科学文献和医疗诉讼中。

“这项研究结果令人不安,但并不意外。”美国微生物学家、图像完整性专家Elisabeth Bik表示,“这不仅引发了对研究完整性的担忧,还给使用成像证据的临床工作流程、保险索赔及法律背景带来了隐患。”

研究人员向来自12家研究中心的17位放射科医生展示了一组X光扫描图像,其中半数为真实扫描图像,半数由AI生成。在不知道研究目的情况下,参与者被问及AI图像的技术质量及是否察觉到任何异常之处。最终,41%的人表示怀疑,认为其中可能混入了AI生成的扫描图像。

接着,放射科医生被告知其中部分图像由AI生成,并被要求辨别真实的扫描图像和由ChatGPT生成的图像。平均而言,参与者正确识别AI与真实图像的概率为75%。论文作者、美国西奈山伊坎医学院的Mickael Tordjman指出,重要的是,“这一结果并未因放射科医生的从业经验不同而产生差异”,他们拥有从0到40年不等的专业经验。

研究团队还探究了ChatGPT和Gemini等AI模型的辨别力是否比放射科医生更敏锐。在区分真实图像与ChatGPT生成的图像时,AI的准确率为57%至85%。

AI生成的图像如此难以辨别,可能会给科学界带来严峻挑战。Tordjman指出,虚假图像可能对诉讼和保险索赔造成干扰。此外,合成的扫描图像也可能渗透到科学文献中。尽管出版商已出台政策禁止或限制使用此类内容,但审稿人和学术期刊仍收到大量包含AI生成图像及医学数据的论文。研究人员担心,包含不准确信息的AI生成内容不仅会误导科学家,也会误导公众。

另一个令人担忧的问题是,用于解读医学影像数据的AI模型,可能被训练数据集中混入的AI生成的数据所扭曲。

与此同时,研究人员发现,合成数据有助于提升放射学AI模型的性能。美国斯坦福大学的Curtis Langlotz指出,如果这些更逼真的AI放射影像能够填补AI模型训练数据中的空白,那么对医学界而言,这可能是一件好事。

该研究设计了一项互动测试,旨在教会研究人员辨别AI生成的X光扫描图像与真实图像。它涵盖了AI生成的放射影像的一些典型特征,如骨骼过于光滑、脊柱异常笔直等。研究人员指出,除了培训放射科医生,数字水印等技术可以使识别真实图像变得更容易,政府机构主导的监管框架也可以这样做。(王铄)

相关论文信息:

https://doi.org/10.1148/radiol.252094

《中国科学报》 (2026-03-26 第2版 国际)