在今年的春晚舞台上,机器仿真蔡明为什么能让人真假难辨?答案或许就藏在人脸的细微变化中。三维人脸关键点检测,是虚拟人拥有生动表情、识别身份、具身智能等多种应用的关键技术环节之一。

然而,传统方法普遍依赖2D纹理辅助或标准3D数字人脸模型,其性能受限于纹理映射误差以及数字人脸与真实人脸之间的差异。此外,由于缺乏大规模、高精度、真实采集且准确标注的3D人脸数据库,直接基于点云的3D人脸关键点检测技术一直面临数据不足与泛化能力弱的问题。

2月26日,中国科学院深圳先进技术研究院集成所机器视觉研究中心研究员宋展团队,与福建理工大学教授叶于平团队合作在《IEEE电路与系统汇刊(视频技术)》(TCSVT)发表的最新研究成果,为解决这一难题提供了全新思路。

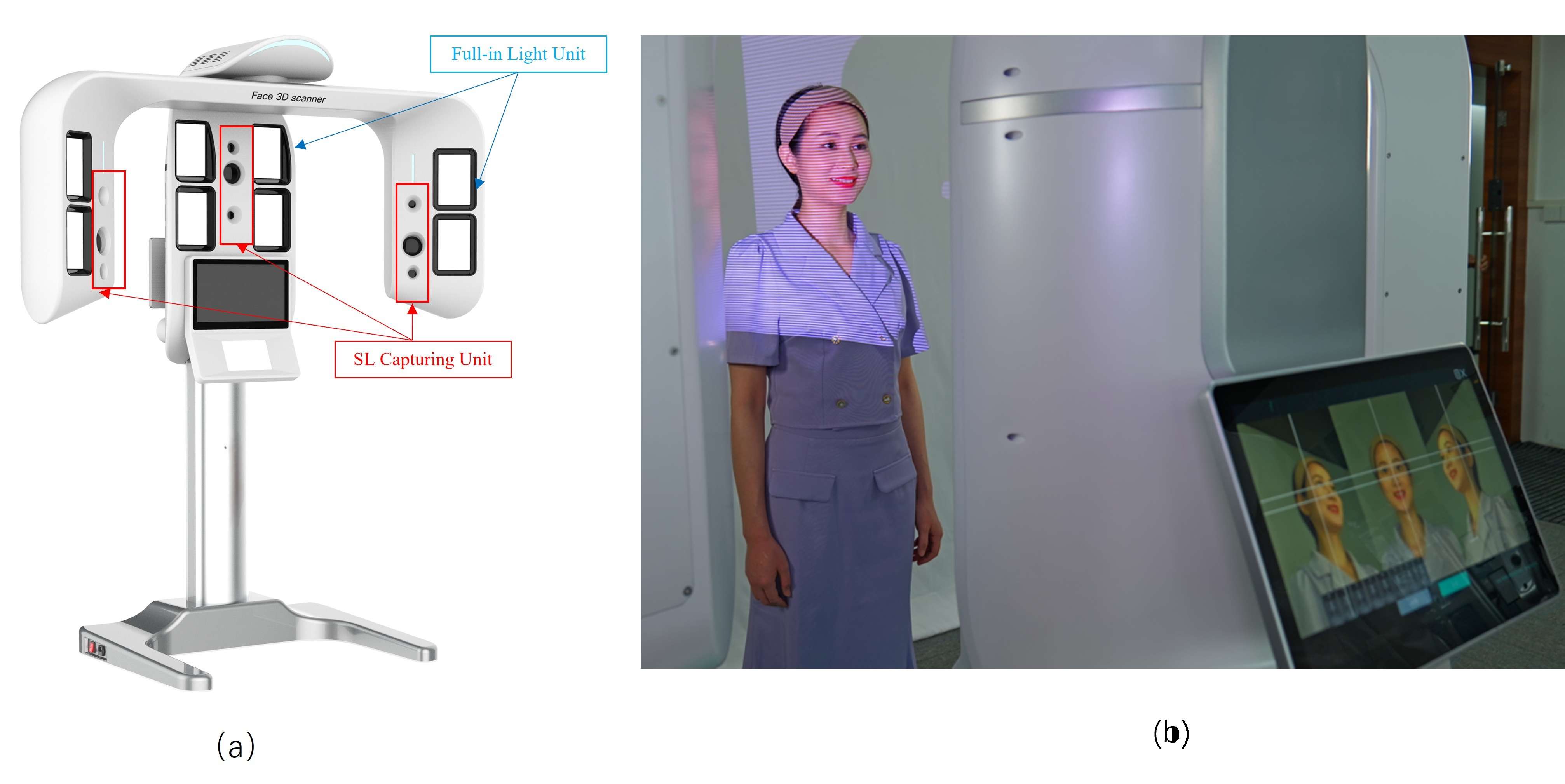

团队自主研制的高精度3D/4D人脸采集设备。研究团队供图

在该研究中,宋展团队基于自主研制的高精度3D/4D人脸采集设备,经过近三年的规范化数据采集与数据库构建,构建出大规模的高精度、真实标注的三维人脸数据库。

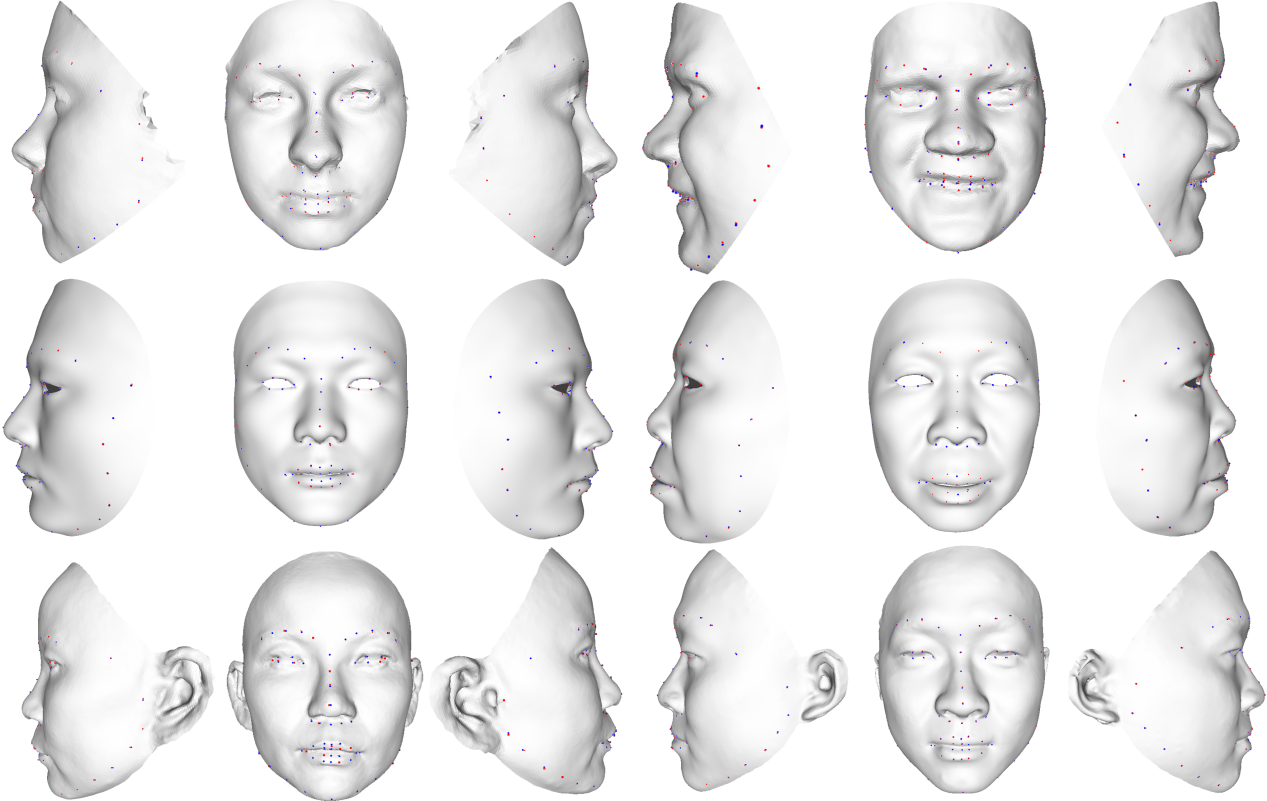

在此基础上,宋展团队联合叶于平团队提出一种面向无序点云的曲率融合图注意力网络(CF GAT),实现从原始3D点云直接预测人脸关键点坐标的高精度检测框架、从“千人一面”到“因人而异”的本质性提升,为高保真度虚拟人面部驱动、机器人脸部表情高逼真度驱动技术提供了基础理论支撑。

在技术上,合作团队首先基于几何驱动的点云采样策略,从原始三维人脸点云中,提取携带曲率信息的简化点集,保留关键几何结构。随后,将曲率编码为显式几何先验融入注意力模块,使网络能够更敏感地捕获局部形状变化,并通过图注意力结构自适应建模点云的局部与全局关系,从而实现对关键点位置的直接预测。该框架有效解决了点云无序性带来的特征表达困难,使模型能够在真实三维数据上获得更稳定、更精确的关键点定位结果。

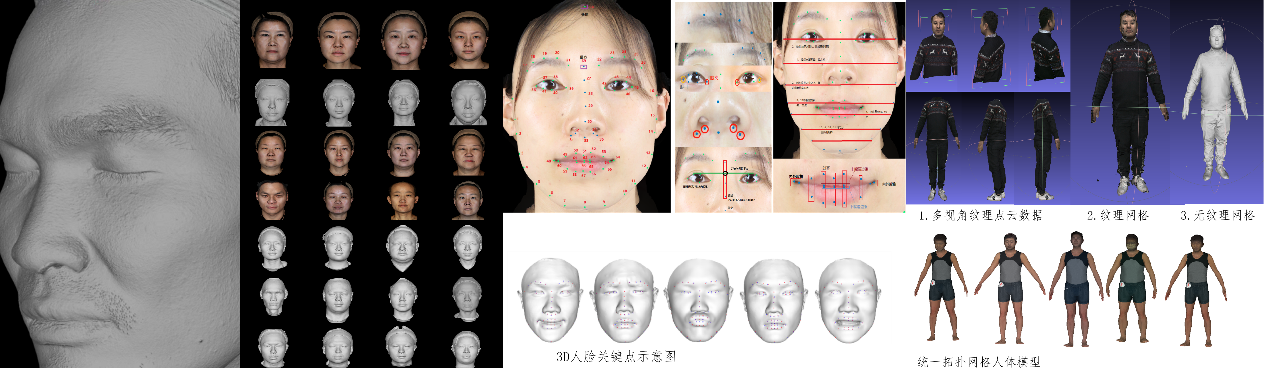

团队近年来构建的多类三维数据集的元数据示意。研究团队供图

“从真假难辨的虚拟人到未来能读懂人类情绪、自然交互的机器人,背后都离不开基础数据的支撑。这一系列数据库已成为仿人机器人关键技术链条中的核心支撑,为高逼真度感知、表达建模与行为生成提供基础数据。”宋展表示,这些数据集未来将进一步服务于数据驱动的大模型仿人机器人体系,以构建更自然、更智能的人机交互能力。

特别声明:本文转载仅仅是出于传播信息的需要,并不意味着代表本网站观点或证实其内容的真实性;如其他媒体、网站或个人从本网站转载使用,须保留本网站注明的“来源”,并自负版权等法律责任;作者如果不希望被转载或者联系转载稿费等事宜,请与我们接洽。