|

|

|

|

|

Digital ChatGPT 相关研究精选: 多领域应用实践与前沿洞察丨 MDPI 编辑荐读 |

|

|

期刊:Digital

期刊主页:https://www.mdpi.com/journal/digital

本期精选 Digital 期刊发表的 5 篇与 ChatGPT 相关的前沿研究文章,主题涵盖了 ChatGPT 在编程任务中的效能对比分析、AI 模型在避孕健康咨询场景下的信息准确性与可读性评估、ChatGPT 驱动的数字化转型在健康、教育与经济领域的应用及伦理挑战、高等教育场景中生成式 AI 使用的伦理认知与评价,以及基于大语言模型对物理学习材料中心智支柱的智能识别与分析。为人工智能相关领域的研究者、教育工作者及行业从业者提供多元视角与实践参考,欢迎阅读。

01. Effectiveness of ChatGPT in Coding: A Comparative Analysis of Popular Large Language Models

ChatGPT在编码中的有效性:主流大语言模型的比较分析

Carlos Eduardo Andino Coello et al.

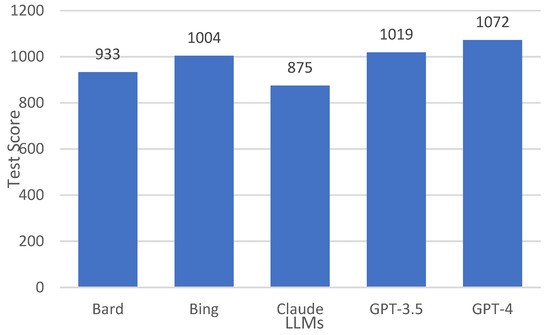

不同大语言模型的性能对比图

本研究探讨了 OpenAI 的 GPT 3.5、GPT 4(ChatGPT)在编程任务中的有效性与效率,分析其对软件开发的潜在影响。研究基于 MBPP 数据集,采用定量方法评估模型性能,并与 Google Bard、Anthropic Claude 等主流大语言模型进行对比。结果显示 ChatGPT 在编程任务中具备明显优势,可为 AI 领域开发者与研究者提供参考,也可视作 AI 辅助编程方向的一项早期探索。

原文出自 Digital期刊

Coello, C.E.A.; Alimam, M.N.; Kouatly, R. Effectiveness of ChatGPT in Coding: A Comparative Analysis of Popular Large Language Models. Digital 2024, 4, 114–125. https://doi.org/10.3390/digital4010005.

02. Comparative Evaluation of Artificial Intelligence Models for Contraceptive Counseling

避孕咨询人工智能模型的比较评估

Anisha V. Patel et al.

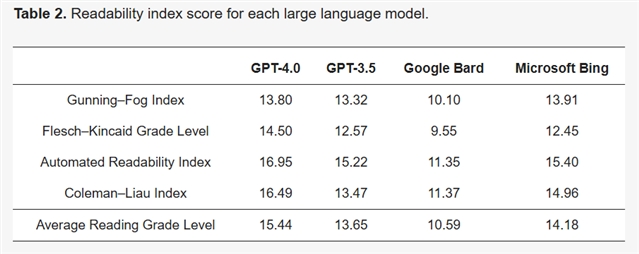

每个大型语言模型的可读性指数得分表

随着数字健康资源普及,评估公开 AI 工具的信息质量对循证患者教育至关重要。本研究评估 ChatGPT 4.0、ChatGPT 3.5、Google Bard、Microsoft Bing 四大模型在避孕咨询回答中的准确性与可读性,采用标准化避孕问题、可读性指标,并由妇产科医师盲审,以美国家庭医师学会(AAFP)指南为基准进行横断面分析。结果显示,各模型在循证性与可读性上存在差异,ChatGPT 3.5 循证性优于 GPT-4.0,但所有模型输出的阅读难度均高于推荐的六年级水平。研究提示,大语言模型仍需优化,以平衡临床准确性与患者可读性,更好地作为医师咨询的辅助工具。

原文出自 Digital 期刊

Patel, A.V.; Jasani, S.; AlAshqar, A.; Doshi, R.H.; Amin, K.; Panakam, A.; Patil, A.; Sheth, S.S. Comparative Evaluation of Artificial Intelligence Models for Contraceptive Counseling. Digital 2025, 5, 10. https://doi.org/10.3390/digital5020010

03.ChatGPT and Digital Transformation: A Narrative Review of Its Role in Health, Education, and the Economy

ChatGPT与数字化转型:在健康、教育和经济领域的作用的叙述性综述

Dag Øivind Madsen and David Matthew Toston II

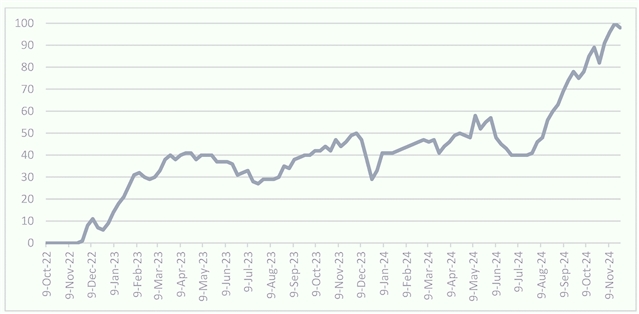

Google Trends 上关于“ChatGPT”的搜索趋势图

OpenAI开发的ChatGPT已迅速融入各行业。本综述探讨了ChatGPT在医疗、教育和经济三大关键领域的角色演变及社会影响,基于近期文献分析了其应用、局限和伦理挑战。在医疗领域,它支持医患沟通和心理健康,但引发虚假信息与隐私担忧;在教育领域,它提供个性化学习与反馈,却使评估和公平问题复杂化;在经济领域,它提升企业运营效率,但也带来失业、数据治理等风险。综述指出,ChatGPT推动数字化转型的同时,对监管和批判性探究提出了新要求,并强调未来需跨学科合作、提升透明度与包容性。

原文出自 Digital 期刊

Madsen, D.Ø.; Toston, D.M.II. ChatGPT and Digital Transformation: A Narrative Review of Its Role in Health, Education, and the Economy. Digital 2025, 5, 24. https://doi.org/10.3390/digital5030024

04.Passing with ChatGPT? Ethical Evaluations of Generative AI Use in Higher Education

借助 ChatGPT 过关?高等教育中生成式人工智能应用的伦理评估

Antonio Pérez-Portabella et al.

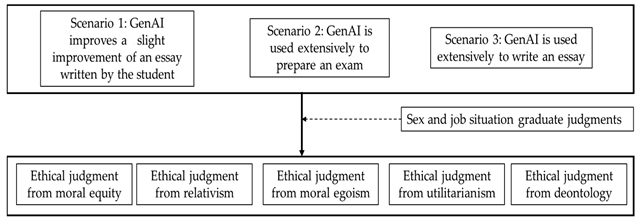

用于评估人们对使用生成式人工智能的伦理认知的分析框架图

生成式人工智能(GenAI)在高等教育中的兴起带来了新机遇与伦理挑战。本研究基于对西班牙社科学生的调查,运用多维伦理量表评估其在三种学术情境(改进论文、备考、完全自动化生成论文)下对GenAI使用的伦理判断。结果显示,学生普遍认为用于改进或准备内容是可接受的,但对完全自动化生成论文表示担忧。性别和就业状态影响伦理评价:女性在功利主义维度上与男性存在差异,在职学生则更倾向于相对主义,并对完全自动化更为宽容。研究强调了背景、个人特征及哲学取向在塑造学术界GenAI使用伦理判断中的重要作用

原文出自 Digital 期刊

Pérez-Portabella, A.; Arias-Oliva, M.; Padilla-Castillo, G.; de Andrés-Sánchez, J. Passing with ChatGPT? Ethical Evaluations of Generative AI Use in Higher Education. Digital 2025, 5, 33. https://doi.org/10.3390/digital5030033

05.Using LLM to Identify Pillars of the Mind Within Physics Learning Materials

运用LLM识别物理学习材料中的思维支柱

Daša ?erveňová and Peter Demkanin

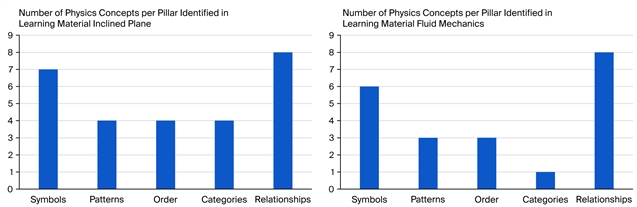

条形图总结了不同主题学习材料中发展出的支柱要素

人工智能工具正快速应用于学习科学领域。本文基于“心智五大支柱”神经网络理论,初步探索了利用大型语言模型(LLM)分析物理教科书。该框架可用于研究物理学习机制,但人工识别文本中对应的支柱概念既耗时又易受主观影响。为此,本研究使用GPT-4o、o4-mini及MAXQDA AI Assist,对一份关于“力”的八页学习材料进行关键概念识别,并将结果与人工分析对比。结果显示,MAXQDA AI Assist表现最佳(精确率1.00,召回率0.67,F1分数0.80);两款OpenAI模型均出现错误识别,导致精确率较低。该方法展现出良好的前景,其未来的发展有望为研究团队提供分析学生书面学习材料、书面作业以及视频记录活动的能力。

原文出自 Digital 期刊

Cerveňová, D.; Demkanin, P. Using LLM to Identify Pillars of the Mind Within Physics Learning Materials. Digital 2025, 5, 47. https://doi.org/10.3390/digital5040047

期刊介绍:

Digital (ISSN 2673-6470) 创刊于2021年,最新Citescore 4.8,致力于为不同领域的学者和专业人士提供一个聚焦数字化时代的开放型和学科交叉型平台,为反映当今世界上数字化发展的最新成果、推动数字化创新以及应用提供借鉴和启示。目前,Digital 期刊已被Scopus, Ei Compendex, dblp Computer Science Bibliography等数据库收录。

期刊主编:

Prof. Dr. Yannis Manolopoulos

University of York, Europe Campus, Thessaloniki, Greece

https://www.mdpi.com/journal/digital

|

2024 CiteScore

|

4.8

|

|

Time to First Decision

|

27.7 Days

|

|

Acceptance to Publication

|

4.9 Days

|

特别声明:本文转载仅仅是出于传播信息的需要,并不意味着代表本网站观点或证实其内容的真实性;如其他媒体、网站或个人从本网站转载使用,须保留本网站注明的“来源”,并自负版权等法律责任;作者如果不希望被转载或者联系转载稿费等事宜,请与我们接洽。